L’intelligenza artificiale oltre che alimentare nuove esperienze di intrattenimento puo’ tornare utile per rendere luighi e servizi accessibili per le persone con difficoltà motorie o visive. Google lo sa, e dal momento che per la società di Mountain View l’accessibilità è e vuole restare una priorità costante ha annunciato nel maggio del 2018, in occasione della conferenza per gli sviluppatori I/O, l’app chiamata Lookout, "un passo per aiutare le persone non vedenti o ipovedenti ad acquisire maggiore indipendenza comprendendo l’ambiente fisico in cui si spostano" come la ha descritta Patrick Clary, Product Manager del Central Accessibility Team di Google. Questa app è ora disponibile nel Play Store, ma è al momento disponibile solo in lingua inglese ed è compatibile solo con smartphone Google Pixel.

Stando a quanto condiviso da Google, sono oltre 253 milioni le persone non vedenti o ipovedenti nel mondo. "Per rendere il mondo più accessibile a loro, serve costruire strumenti che possano lavorare con l’ambiente in continua evoluzione che ci circonda" ha detto Clary, secondo cui la nuova app Lookout per device Android "aiuta le persone non vedenti o ipovedenti a diventare più indipendenti dando spunti uditivi mentre incontrano oggetti, testo e persone che li circondano".

Google annuncia la app Lookout

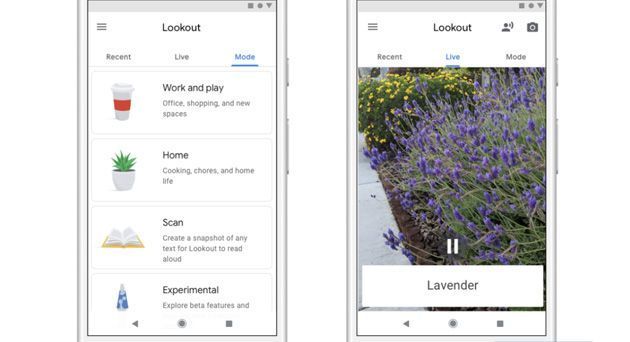

Google invita gli utilizzatori di Lookout di portare il dispositivo su cui l’app è stata installata in un cordino al collo o nel taschino della camicia, con la fotocamera puntata lontano dal corpo. Dopo aver aperto l’app e selezionato una modalità tra le quattro disponibili [Casa, Work & Play, Scansione o Sperimentale (questa permette di testare le funzionalità ancora in sviluppo)] Lookout elabora gli elementi che ‘vede attraverso l’obiettivo fotografico’ e condivide le informazioni che ritiene siano rilevanti con l’utente: il testo da un ricettario o la posizione di un bagno, un’uscita, una rampa di scale, una sedia o una persona nelle vicinanze. Lookout offre notifiche vocali, progettate per essere utilizzate con un’interazione minima per consentire alle persone di non essere distratte e di rimanere impegnate con l’attività che stanno svolgendo.

Quando si seleziona una modalità specifica, Lookout fornisce informazioni rilevanti in base alla selezione fatta. Ad esempio, se l’utente si sta preparando a svolgere le faccende quotidiane puo’ selezionare la modalità "Casa" per sentire le notifiche che gli dicono dove si trovano oggetti come il divano, il tavolo o la lavastoviglie rispetto alla propria posizione (ad esempio "divano a ore 3" significa che il divano è alla destra dell’utente). Attivando la modalità "Work & Play" mentre si è in ufficio è possibile sapere quando ci si trova nelle vicinanze di un ascensore o della tromba delle scale.

Grazie all’apprendimento automatico, nel tempo, man mano che più persone useranno l’app, Lookout apprenderà sempre nuove informazioni per adattarsi meglio a quelle che sono le esigenze degli utenti. L’esperienza di base viene elaborata sul dispositivo, il che significa che l’app può essere utilizzata senza una connessione Internet.

"Abbiamo progettato Lookout per funzionare in situazioni in cui le persone potrebbero dover chiedere aiuto, ad esempio imparare a conoscere un nuovo spazio per la prima volta, leggere testi e documenti e completare le routine quotidiane come cucinare, pulire e fare shopping" ha spiegato Clary. "Tenendo o indossando il tuo dispositivo, Lookout ti parla di persone, testo, oggetti e molto altro mentre ti muovi attraverso uno spazio. Una volta aperta l’app Lookout, tutto ciò che devi fare è tenere il telefono puntato in avanti. Non dovrai toccare altri pulsanti all’interno dell’app, quindi puoi concentrarti su ciò che stai facendo in quel momento".

Lookout di Google è disponibile sul Play Store negli Stati Uniti per dispositivi Google Pixel, non ci sono informazioni circa la disponibilità in futuro in altre lingue e in altri paesi.